Robots d’indexation : l’indexation sur les moteurs de recherche

- Qu’est-ce qu’un spider ?

- Qu’est-ce qu'un robot d’exploration ?

- Robot d'exploration et robot d'indexation : quelles différences ?

- Quels sont les différents robots d'exploration du web ?

- Comment utiliser un robot de crawl pour une stratégie SEO optimale ?

- Quels outils utiliser pour crawler mon site web ?

Qu’est-ce qu’un spider ?

Savez-vous comment Google fait pour explorer vos pages web puis les classer dans son moteur de recherche ? Il utilise des robots d’exploration, appelés également spiders. Ces entités automatisées jouent un rôle important dans la façon dont les informations sont indexées et présentées aux internautes. Mais qu'est-ce qu'un robot d'exploration exactement, et pourquoi sont-ils appelés "spiders" ? Comment diffèrent-ils des robots d'indexation, et quelles sont leurs fonctions spécifiques dans l'écosystème numérique ?Qu’est-ce qu'un robot d’exploration ?

Un robot d'exploration, souvent désigné sous le terme de robots crawler, est un programme informatique automatisé conçu pour parcourir le web de manière méthodique et automatisée. Sa fonction principale est de visiter les sites web en suivant les liens d'une page à l'autre. Ce processus permet de récupérer et d'analyser le contenu des pages pour diverses utilisations, notamment pour l'indexation par les moteurs de recherche. Les tâches de ce robot comprennent principalement l'exploration des sites web et la collecte de données. En naviguant à travers les pages web, ils capturent le contenu, les liens, et les métadonnées, contribuant ainsi à la construction d'une carte exhaustive du contenu disponible sur Internet. Cette cartographie est ensuite utilisée par les moteurs de recherche pour classer et présenter les résultats de recherche aux utilisateurs. Mais d'où vient le terme “spider” ? Cette appellation trouve son origine dans la manière dont ces robots opèrent, similaire à celle d'une araignée explorant sa toile. Tout comme l'animal qui tisse sa toile et se déplace de fil en fil pour capturer ses proies, un robot d'exploration tisse son chemin à travers le vaste réseau du web, se déplaçant de lien en lien pour collecter des informations. Cette analogie souligne la capacité du robot d’exploration à couvrir une vaste étendue du web, détectant et enregistrant les informations à mesure qu'il progresse dans sa toile numérique.Robot d'exploration et robot d'indexation : quelles différences ?

Bien que les termes "robot d'exploration" et "robot d'indexation" soient souvent utilisés de manière interchangeable, ils décrivent en réalité deux fonctions distinctes dans l'écosystème du web. Le rôle principal d’un robot d’exploration est de parcourir le web, de suivre les liens et de découvrir de nouvelles pages ainsi que des mises à jour sur des pages existantes. Son objectif est de collecter des données sur le contenu des pages, comme le texte, les images et les vidéos, et les liens qu'elles contiennent. Il opère en continu pour maintenir une base de données à jour des contenus disponibles en ligne. Les robots d'indexation entrent en jeu après la collecte des données par les robots d'exploration. Ils analysent les informations recueillies pour organiser et indexer le contenu. Cela implique de classer et de stocker les pages de manière à ce qu'elles puissent être récupérées rapidement par les moteurs de recherche lorsqu'un utilisateur effectue une recherche. L'indexation est un processus complexe qui implique l'analyse des mots-clés, la pertinence du contenu, et la structure des pages web. Ces deux types de robots travaillent ensemble pour optimiser la recherche en ligne. Les robots d'exploration découvrent et collectent les données, tandis que les robots d'indexation classent et organisent ces données pour faciliter les requêtes des utilisateurs. Pour être encore plus concis, un spider va se concentrer sur la découverte et la collecte des données et suivre les liens d'une page à l'autre. Par exemple : Googlebot Explorer, qui parcourt le web pour trouver de nouvelles pages et mises à jour. Un robot d’indexation va traiter et organiser les données collectées puis analyser le contenu afin de déterminer sa pertinence et sa qualité. Par exemple : Le processus d'indexation de Google, qui trie et classe le contenu pour les requêtes de recherche.Quels sont les différents robots d'exploration du web ?

Plusieurs robots d'exploration jouent un rôle clé sur Internet. Ces spiders appartiennent aux moteurs de recherche les plus utilisés et chacun a des caractéristiques spécifiques. Il existe également des robots d’exploration développés par des entreprises professionnelles afin que vous testiez la capacité de votre site à être exploré par ces robots.- Googlebot : Le plus connu, c’est le robot de Google. Sa tâche est de parcourir le web pour indexer de nouvelles pages et mettre à jour les informations des pages existantes. Googlebot utilise des algorithmes complexes pour déterminer la fréquence et la profondeur de ses crawls. GoogleBot crawl les contenus pour smartphone, ordinateur, mais également les images, les news ou encore les vidéos.

- Bingbot : Il sert le moteur de recherche Bing de Microsoft. Bingbot fonctionne de manière similaire à Googlebot mais suit ses propres algorithmes pour indexer les pages web. Il est conçu pour comprendre le contexte et la pertinence du contenu.

- Yandexbot : Utilisé principalement par le moteur de recherche russe Yandex, ce robot se concentre sur les contenus pertinents pour les utilisateurs russophones. Il a une approche unique pour explorer et indexer les pages, adaptée aux préférences et aux comportements de recherche de son audience principale.

Comment utiliser un robot de crawl pour une stratégie SEO optimale ?

Vous souhaitez utiliser efficacement les spiders dans une stratégie SEO ? Dans un premier temps, il est impératif que votre site soit optimal. Pour cela, utilisez régulièrement des outils de crawl pour identifier et corriger les problèmes techniques sur votre site. Cela inclut la vérification des liens brisés, des erreurs 404, et des problèmes de redirection. Ainsi, vous vous assurez que vos contenus soient facilement accessibles et indexables par les spiders de Google. Cela implique l'utilisation de balises meta pertinentes, de structures d'URL claires, et d'un sitemap à jour. Vous pourrez ensuite utiliser les données recueillies par les robots de crawl pour analyser la performance de votre site. Cela comprend l'étude des mots-clés, l'analyse de la structure des liens internes, et l'évaluation de la vitesse de chargement des pages. Enfin, soyez attentif aux modifications apportées par les moteurs de recherche dans leurs algorithmes et ajustez votre stratégie en conséquence.Quels outils utiliser pour crawler mon site web ?

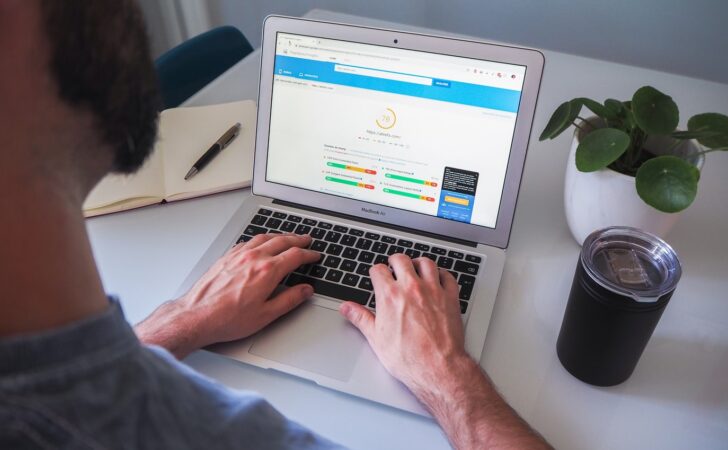

L'utilisation stratégique des outils de crawl est indispensable pour optimiser le référencement d'un site web. Ces outils imitent le comportement des robots d'indexation et d’exploration des moteurs de recherche. Ils fournissent ainsi des insights précieux sur la façon dont un site est perçu et indexé. Voici quelques-uns des outils de crawl les plus populaires :- Screaming Frog SEO Spider : Un outil de crawl très complet qui analyse en profondeur un site web. Il fournit des informations sur les liens, les images, les CSS, les scripts, et plus encore, aidant à identifier les problèmes SEO comme les liens brisés, les redirections, et les erreurs de page.

- Google Search Console : Cet outil gratuit offre une vue d'ensemble sur la manière dont Google voit votre site. Il permet de vérifier l'indexation des pages, de soumettre des sitemaps, et de comprendre les problèmes de performance qui pourraient affecter le classement.

- Ahrefs Site Audit : Ahrefs propose un outil d'audit de site qui crawl votre site web et génère un rapport détaillé. Il est utile pour détecter les problèmes techniques, surveiller la santé SEO du site, et suivre les améliorations au fil du temps.

Articles similaires

Référencement naturel

ChatGPT après un an d’utilisation : le point sur mon aventure

Jeudi 11 Avril, 2024

Lire cet article

Référencement naturel

Le VSEO ou le référencement naturel de ses vidéos

Mardi 26 Mars, 2024

Lire cet article

Référencement naturel

Quand la stratégie SEO rencontre la politique RSE : le début de l’ère du RSEO ?

Lundi 18 Mars, 2024

Lire cet article

Référencement naturel

Pourquoi devez-vous adapter votre stratégie SEO aux Marronniers ?

Lundi 22 Janvier, 2024

Lire cet article

Référencement naturel

Préparez vos soldes d’hiver pour booster vos ventes

Mercerdi 10 Janvier, 2024

Lire cet article

Référencement naturel

Quels seront les futurs grands changements du SEO pour 2024 ?

Lundi 11 Décembre, 2023

Lire cet article

Référencement naturel

Nouveau moteur de recherche Yahoo : une menace sérieuse pour Google ?

Mercerdi 06 Décembre, 2023

Lire cet article

Référencement naturel

Comment l’IA peut-elle redonner vie à vos anciens articles de blog ?

Mercerdi 22 Novembre, 2023

Lire cet article

Référencement naturel

Google Discover bientôt disponible sur desktop ?

Vendredi 03 Novembre, 2023

Lire cet article

Référencement naturel

25 ans Google : Un géant toujours en quête d’innovation

Vendredi 13 Octobre, 2023

Lire cet article

Référencement naturel

Search Generative Expérience, une révolution pour le SEO ?

Jeudi 14 Septembre, 2023

Lire cet article

Référencement naturel

Les recherches associées : Quel impact pour votre SEO ?

Mardi 22 Août, 2023

Lire cet article

Référencement naturel

Title Gate : pourquoi Google réécrit-il vos titres ?

Jeudi 10 Août, 2023

Lire cet article

Référencement naturel

Critère INP : quel impact pour les Core Web Vitals ?

Lundi 31 Juillet, 2023

Lire cet article

Référencement naturel

EEAT Google : comment répondre aux nouveaux critères ?

Mardi 25 Juillet, 2023

Lire cet article

Référencement naturel

Balise Alt SEO : Définition, rôle & optimisations

Lundi 06 Juin, 2022

Lire cet article

Référencement naturel

Comment utiliser Google Keyword Planner pour votre SEO ?

Lundi 06 Juin, 2022

Lire cet article

Référencement naturel

Core Vitals : l’UX comme indicateur de qualité pour Google

Lundi 06 Juin, 2022

Lire cet article

Référencement naturel

Core Web Vitals : Comment les améliorer ?

Samedi 04 Juin, 2022

Lire cet article

Référencement naturel

Infographie : Comment optimiser le SXO de son site web ?

Vendredi 25 Juin, 2021

Lire cet article

Référencement naturel

Infographie : Comment booster votre SEO sur Amazon ?

Infographie : Comment booster votre SEO sur Amazon ?

Infographie : Comment booster votre SEO sur Amazon ?

Infographie : Comment booster votre SEO sur Amazon ?

Jeudi 29 Avril, 2021

Lire cet article

Référencement naturel

Infographie : Comment booster votre SEO sur Youtube ?

Infographie : Comment booster votre SEO sur Youtube ?

Infographie : Comment booster votre SEO sur Youtube ?

Infographie : Comment booster votre SEO sur Youtube ?

Vendredi 09 Avril, 2021

Lire cet article

Référencement naturel

Infographie : Comment booster votre SEO local ?

Infographie : Comment booster votre SEO local ?

Infographie : Comment booster votre SEO local ?

Infographie : Comment booster votre SEO local ?

Jeudi 18 Mars, 2021

Lire cet article

Référencement naturel

SEO - SEA - SEM : On vous dit tout !

SEO - SEA - SEM : On vous dit tout !

SEO - SEA - SEM : On vous dit tout !

SEO - SEA - SEM : On vous dit tout !

Mercerdi 07 Octobre, 2020

Lire cet article

Référencement naturelRéférencement payant

Google Keyword Planner : le planificateur de mots clés Google

Google Keyword Planner : le planificateur de mots clés Google

Google Keyword Planner : le planificateur de mots clés Google

Google Keyword Planner : le planificateur de mots clés Google

Mardi 23 Juin, 2020

Lire cet article

Référencement naturel

Infographie : Les meilleurs acteurs sur la recherche vocale #2

Infographie : Les meilleurs acteurs sur la recherche vocale #2

Infographie : Les meilleurs acteurs sur la recherche vocale #2

Infographie : Les meilleurs acteurs sur la recherche vocale #2

Jeudi 04 Juin, 2020

Lire cet article

Référencement naturel

Les 5 avantages clés d'une stratégie SEO & les 3 piliers du référencement

Les 5 avantages clés d'une stratégie SEO & les 3 piliers du référencement

Les 5 avantages clés d'une stratégie SEO & les 3 piliers du référencement

Les 5 avantages clés d'une stratégie SEO & les 3 piliers du référencement

Mardi 02 Juin, 2020

Lire cet article

Référencement naturel

Infographie : Les meilleurs acteurs sur la recherche vocale #1

Infographie : Les meilleurs acteurs sur la recherche vocale #1

Infographie : Les meilleurs acteurs sur la recherche vocale #1

Infographie : Les meilleurs acteurs sur la recherche vocale #1

Mercerdi 27 Mai, 2020

Lire cet article

Référencement naturel

Google May Core Update 2020 : Mise à jour majeure de l'algorithme

Google May Core Update 2020 : Mise à jour majeure de l'algorithme

Google May Core Update 2020 : Mise à jour majeure de l'algorithme

Google May Core Update 2020 : Mise à jour majeure de l'algorithme

Mercerdi 06 Mai, 2020

Lire cet article

Référencement naturel

Comment s'en sortir avec une pénalité Google ?

Comment s'en sortir avec une pénalité Google ?

Comment s'en sortir avec une pénalité Google ?

Comment s'en sortir avec une pénalité Google ?

Mardi 28 Avril, 2020

Lire cet article

Référencement naturel

UX et SEO : Comment allier les 2 pour booster votre visibilité ?

UX et SEO : Comment allier les 2 pour booster votre visibilité ?

UX et SEO : Comment allier les 2 pour booster votre visibilité ?

UX et SEO : Comment allier les 2 pour booster votre visibilité ?

Jeudi 23 Avril, 2020

Lire cet article

Référencement naturel

Qu'est ce que la recherche vocale ou vocal search ?

Qu'est ce que la recherche vocale ou vocal search ?

Qu'est ce que la recherche vocale ou vocal search ?

Qu'est ce que la recherche vocale ou vocal search ?

Vendredi 03 Avril, 2020

Lire cet article

Référencement naturel

La position 0 dans Google... Utile ou futile ?

La position 0 dans Google... Utile ou futile ?

La position 0 dans Google... Utile ou futile ?

La position 0 dans Google... Utile ou futile ?

Mardi 31 Mars, 2020

Lire cet article

Référencement naturel

Les microdonnées : utiles pour un meilleur référencement ?

Les microdonnées : utiles pour un meilleur référencement ?

Les microdonnées : utiles pour un meilleur référencement ?

Les microdonnées : utiles pour un meilleur référencement ?

Jeudi 26 Mars, 2020

Lire cet article

Référencement naturel

Comment est-ce-que la dégradation des contenus affecte votre SEO ? (content decay)

Comment est-ce-que la dégradation des contenus affecte votre SEO ? (content decay)

Comment est-ce-que la dégradation des contenus affecte votre SEO ? (content decay)

Comment est-ce-que la dégradation des contenus affecte votre SEO ? (content decay)

Mardi 17 Mars, 2020

Lire cet article

Référencement naturel

Boostez votre référencement grâce aux techniques off-site

Boostez votre référencement grâce aux techniques off-site

Boostez votre référencement grâce aux techniques off-site

Boostez votre référencement grâce aux techniques off-site

Mardi 10 Mars, 2020

Lire cet article

Référencement naturel

Stratégie de netlinking & Topical Trust Flow (TTF)

Stratégie de netlinking & Topical Trust Flow (TTF)

Stratégie de netlinking & Topical Trust Flow (TTF)

Stratégie de netlinking & Topical Trust Flow (TTF)

Jeudi 05 Mars, 2020

Lire cet article

Référencement naturel

SEO : Pourquoi et comment être référencé dans Google Actualités ?

SEO : Pourquoi et comment être référencé dans Google Actualités ?

SEO : Pourquoi et comment être référencé dans Google Actualités ?

SEO : Pourquoi et comment être référencé dans Google Actualités ?

Mardi 25 Février, 2020

Lire cet article

Référencement naturel

Qu'est-ce que l'Answer Engine Optimization ou "moteur de réponse" Google ?

Qu'est-ce que l'Answer Engine Optimization ou "moteur de réponse" Google ?

Qu'est-ce que l'Answer Engine Optimization ou "moteur de réponse" Google ?

Qu'est-ce que l'Answer Engine Optimization ou "moteur de réponse" Google ?

Mercerdi 29 Janvier, 2020

Lire cet article

Référencement naturel

9 tendances SEO que vous ne pouvez pas ignorer en 2020

9 tendances SEO que vous ne pouvez pas ignorer en 2020

9 tendances SEO que vous ne pouvez pas ignorer en 2020

9 tendances SEO que vous ne pouvez pas ignorer en 2020

Mardi 07 Janvier, 2020

Lire cet article

Référencement naturel

Infographie sur la recherche vocale : statistiques et constats

Infographie sur la recherche vocale : statistiques et constats

Infographie sur la recherche vocale : statistiques et constats

Infographie sur la recherche vocale : statistiques et constats

Jeudi 14 Novembre, 2019

Lire cet article

Référencement naturel

SEO : En quoi la tendance à la recherche visuelle fait-elle évoluer le référencement ?

SEO : En quoi la tendance à la recherche visuelle fait-elle évoluer le référencement ?

SEO : En quoi la tendance à la recherche visuelle fait-elle évoluer le référencement ?

SEO : En quoi la tendance à la recherche visuelle fait-elle évoluer le référencement ?

Jeudi 14 Février, 2019

Lire cet article

Référencement naturel

Qu'est-ce qu'un PAA : People Also Ask?

Qu'est-ce qu'un PAA : People Also Ask?

Qu'est-ce qu'un PAA : People Also Ask?

Qu'est-ce qu'un PAA : People Also Ask?

Mercerdi 03 Janvier, 2018

Lire cet article

Référencement naturel

Les causes possibles pouvant freiner votre référencement naturel

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Quels sont les risques liés au passage en https ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Caractères spéciaux et paramètres d'URL

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi le Javascript et l'Ajax posent-ils problème pour le référencement naturel ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Mon site est construit avec des frames, est-il possible d’optimiser son référencement naturel ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

La balise hreflang est-elle importante pour le référencement de mon site Internet ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Quels sont les freins techniques pour le référencement d’un site réalisé en Flash ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi certains menus posent problème pour le référencement naturel ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi les formulaires peuvent-ils freiner le référencement de mon site Internet ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

J’ai un site Internet réalisé en flash, est-il possible d’optimiser son référencement naturel sur Google ?

Jeudi 28 Décembre, 2017

Lire cet article

Référencement naturel

Quelles sont les sanctions et pénalités de Google ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

La perte de position sur Google en référencement naturel

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Mon site a perdu ses positions QUE sur quelques mots clés, pourquoi ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Mon site a perdu toutes ses positions dans Google d’un seul coup, pourquoi ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Site blacklisté par Google : que faire ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Quelles sont les sanctions infligées par Google Panda ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Comment choisir un nom de domaine optimisé pour le référencement SEO ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Que faut-il faire en cas de pénalité Google ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Comment savoir si mon site est pénalisé par Google ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

A quelles dates ont eu lieu les mises à jour Google Panda ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Que sont les filtres algorithmiques ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi le Page Rank de mon site Internet a-t-il baissé ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Qu'est-ce que le cloaking en SEO ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

L’url rewriting est-elle importante pour le référencement naturel de mon site ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

URL rewriting (réécriture d'URL) : comment procéder ?

Mercerdi 27 Décembre, 2017

Lire cet article

Référencement naturel

Référencement et création de site Internet

Vendredi 22 Décembre, 2017

Lire cet article

Référencement naturel

Cocon sémantique en SEO : exemples

Vendredi 22 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi faut-il travailler la longue traîne en référencement naturel ?

Vendredi 22 Décembre, 2017

Lire cet article

Référencement naturel

Tout savoir sur la Google Search Console

Jeudi 21 Décembre, 2017

Lire cet article

Référencement naturel

Mon site vient d’être créé, Que dois-je faire pour le référencer ?

Jeudi 21 Décembre, 2017

Lire cet article

Référencement naturel

White Hat SEO, Black Hat SEO : de quoi s'agit-il ?

Jeudi 21 Décembre, 2017

Lire cet article

Référencement naturel

Optimisation de votre site pour le SEO

Jeudi 21 Décembre, 2017

Lire cet article

Référencement naturel

Pour aller plus loin en référencement naturel ….

Jeudi 21 Décembre, 2017

Lire cet article

Référencement naturel

Quels sont les meilleurs outils permettant de suivre les positions de mon site Internet en référencement naturel ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Suivre les résultats de votre référencement naturel

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Référencement des fichiers PDF / Word

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Généralités sur le référencement naturel

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Quels sont les différents types de Rich Snippet ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Comment améliorer sa visibilité sur Google ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Faut-il passer son site en mode sécurisé https ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Est-il possible de faire apparaître les sitelinks que l’on veut ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Comment être positionné en position 0 sur Google ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Comment savoir si la position 0 impact le trafic ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Comment savoir si une de mes pages s’affichent en position 0 ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Quels types d’informations s’affichent en position 0 ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Est-ce que je peux écrire du texte blanc sur fond blanc ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Est-ce que je peux cacher du texte dans les pages de mon site Internet ?

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Grey hat SEO : les tehniques du Grey hat en SEO

Mardi 19 Décembre, 2017

Lire cet article

Référencement naturel

Quelle est la différence entre référencement naturel et référencement payant ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Comment construire un cocon sémantique ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que le fichier robots.txt ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Existent-ils différents fichiers sitemaps ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Comment créer un fichier sitemap.xml ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Qu'est-ce qu'un fichier sitemap.xml et comment le trouver ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Quelle est la part de marché des moteurs de recherche en France ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Est-il possible de travailler sur d’autres moteurs de recherche que Google ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Comment les moteurs positionnent les pages de mon site dans leurs résultats ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Quelle est la différence entre référencement et positionnement ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

En quoi est-ce utile de faire du référencement naturel si je fais déjà de l’adwords ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Le référencement payant Adwords permet-il d’être bien référencé naturellement ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que l’url d’un site Internet ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Quels sont les critères d’optimisation d’un fichier pdf en référencement naturel ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Est-il possible de référencer un fichier pdf ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Quels critères mon site doit respecter pour apparaître dans Google Actualités ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Dois-je respecter une fréquence de publication de mes articles minimum ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Comment apparaître dans Google Actualités ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Dois-je avoir une adresse physique pour apparaître dans le référencement Local ?

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Autres types de référencement naturel

Lundi 18 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi mon site ne ressort pas dans Google ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Faciliter l’indexation de vos pages dans les moteurs pour le référencement

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi le fichier sitemap est important pour le référencement naturel ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que le knowledge graph ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que le duplicate content ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce qu’une balise canonical et comment la mettre en place ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Balise canonical et duplication de contenu

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Index principal et secondaire de Google

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Comment savoir dans quel index mes pages se trouvent ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que l’index secondaire de Google ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que l’index principal de Google ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Accessibilité de votre site par des urls distinctes

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Quels sont les types d’url pour lesquelles mon site est susceptible d’être accessible ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

J’ai de nombreux produits où seule la couleur change, comment faire pour le référencement ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Mes fiches produits possèdent les mêmes descriptifs produits, est-ce problématique ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi les balises de mon site sont dupliquées ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Le catalogue produit de mon fournisseur est identique à celui de mon site, est-ce problématique pour le référencement ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

J’ai copier/coller du texte depuis d’autres sites Internet, est-ce répréhensible ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Quels types de liens sont les plus faciles à obtenir pour indexer un site Internet ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Les liens externes : le netlinking

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Les liens peuvent-il faciliter l’indexation des pages de mon site Internet ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Le formulaire de soumission de Google

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Création d’une page d’accueil provisoire

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que le formulaire de soumission Google ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

A quoi sert le formulaire de soumission Google ?

Vendredi 15 Décembre, 2017

Lire cet article

Référencement naturel

Quel est l’impact d’une vidéo sur le référencement ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est ce que le référencement vidéo ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que le référencement image ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Quels sont les critères d’optimisation d’une image en référencement naturel ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Comment augmenter l’indice de confiance de mon site Internet ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

L’url d’un site est-elle importante pour le référencement naturel ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Qu'est-ce que la balise title et comment la modifier ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que la balise meta description ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Comment utiliser la balise meta description ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Titre H1 : longueur balise H1 & autres astuces d'optimisation

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Balises de mise en forme de contenu Hn

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Quelle est la longueur d’une balise h1 ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Le texte de mes pages est-il important pour le référencement ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Combien de mots dois-je écrire sur chacune de mes pages pour être bien référencé ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

La structure de mon texte est-elle importante pour le référencement naturel ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Les liens entre les pages de mon site sont-ils importants pour le référencement ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Comment connaitre le pagerank de mon site Internet ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Comment augmenter le pagerank de mon site Internet ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Le PageRank est-il lié avec le positionnement de mon site Internet ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Quelle est la différence entre le TF / Trust Flow et le CF / Citation Flow ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que l’indice de popularité en référencement naturel ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Existe-t-il des logiciels pour trouver des liens pour le référencement ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Comment trouver de bons liens pour le référencement ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce qu’un lien de qualité en référencement naturel ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Combien de liens me faut-il pour que mon site soit bien référencé ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Vaut-il mieux 100 liens depuis des petits blogs ou 1 lien depuis un site institutionnel ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

L’achat de lien est-il autorisé par Google ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Combien coûte l’achat de lien sur un site de confiance et à très fort trafic ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Est-il possible d’acheter des liens ?

Jeudi 14 Décembre, 2017

Lire cet article

Référencement naturel

Qu’est-ce que le référencement naturel ?

Mercerdi 13 Décembre, 2017

Lire cet article

Référencement naturel

Comment connaître la concurrence d’un mot clé ?

Mercerdi 13 Décembre, 2017

Lire cet article

Référencement naturel

Comment connaître le volume de recherche d’un mot-clé ?

Mercerdi 13 Décembre, 2017

Lire cet article

Référencement naturel

Comment fonctionne Google Suggest ?

Mercerdi 13 Décembre, 2017

Lire cet article

Référencement naturel

Pourquoi certaines expressions apparaissent dans Google Suggest et pas d’autres ?

Mercerdi 13 Décembre, 2017

Lire cet article

Référencement naturel

Comment trouver des mots clés longue traine ?

Mardi 12 Décembre, 2017

Lire cet article

Référencement naturel

Mots-clés & référencement de longue traîne en SEO

Vendredi 10 Novembre, 2017

Lire cet article

Référencement naturel

Intérêt et concurrence d’un mot clé

Vendredi 10 Novembre, 2017

Lire cet article

Référencement naturel

Comment trouver les bons mots clés ?

Vendredi 10 Novembre, 2017

Lire cet article

Référencement naturel

Référencement organique VS référencement payant

Vendredi 10 Novembre, 2017

Lire cet article

Référencement naturel

Comment optimiser le contenu d’une page ?

Mercerdi 29 Mars, 2017

Lire cet article

Référencement naturel

Comment choisir les bons mots clés pour bien référencer son site ?

Mercerdi 29 Mars, 2017

Lire cet article

Référencement naturel

8 conseils pour optimiser le SEO de vos épingles Pinterest !

8 conseils pour optimiser le SEO de vos épingles Pinterest !

8 conseils pour optimiser le SEO de vos épingles Pinterest !

8 conseils pour optimiser le SEO de vos épingles Pinterest !

Mardi 03 Mai, 2016

Lire cet article

Référencement naturel

Dois-je répéter certains mots avec des caractères accentués et des majuscules dans mes balises Meta ?

Mardi 19 Mars, 2013

Lire cet article

Référencement naturel

J'ai pensé mettre dans mes balises Keywords le nom de mes concurrents. Est-ce raisonnable ?

Mardi 19 Mars, 2013

Lire cet article

Référencement naturel

Pour quels mots clés dois-je demander un positionnement ?

Mardi 19 Mars, 2013

Lire cet article

Référencement naturel

Dois-je confier le référencement de mon site à un professionnel du domaine ?

Mardi 19 Mars, 2013

Lire cet article